ISO/IEC 42001 Yapay Zeka Yönetim Sistemi

kullanici2

Mart 6, 2026

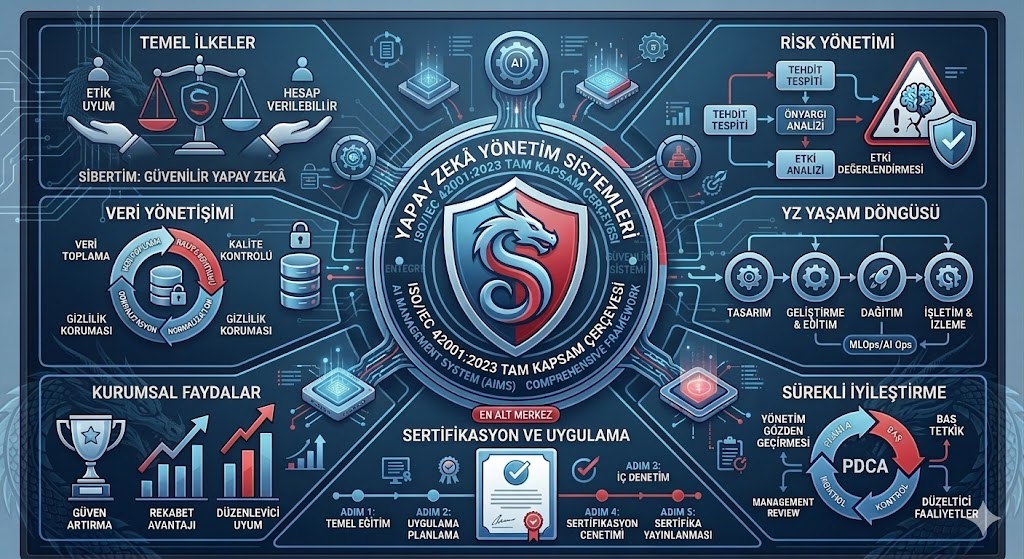

ISO/IEC 42001:2023 Nedir?

ISO/IEC 42001:2023, Yapay Zekâ Yönetim Sistemleri (AIMS) için kapsamlı bir çerçeve sunarak, organizasyonların yapay zekâ teknolojilerini etik, şeffaf ve sorumlu bir şekilde kullanmalarını sağlamayı amaçlayan bir uluslararası standarttır. Bu standart, yapay zekâ sistemlerinin etkili bir şekilde yönetilmesi için gerekli uygulamaları ortaya koyar ve bu sistemlerin etik ilkelere ve toplumsal değerlere uygun olarak çalışmasını garanti altına alır.

ISO/IEC 42001:2023 Kapsamı ve AIMS Çerçevesi

ISO/IEC 42001, yapay zekâ yönetimi ile ilgili geniş bir yelpazeyi kapsar. Bu, yapay zekâ sistemlerinin geliştirilmesi, uygulanması ve sürekli olarak iyileştirilmesi gibi faaliyetleri içerir. Standardın amacı, etik yapay zekâ kullanımını teşvik etmek, şeffaflığı artırmak ve yapay zekâ uygulamalarında hesap verebilirliği yaygınlaştırmaktır. Organizasyonlar, bu standart sayesinde yapay zekâ ile ilgili faaliyetlerini düzenlerken, toplumsal sorumluluklarını yerine getirebilir ve etik kurallar çerçevesinde hareket edebilirler.

Etik Yapay Zekâ Kullanımını ve Şeffaflığı Teşvik Etmek

AIMS çerçevesi, yapay zekâ yönetiminde etik ilkelerin önemini vurgular. Etik ilkeler, adalet ve hesap verebilirlik gibi değerlerin yapay zekâ sistemlerine entegre edilmesi için yapılandırılmış bir yaklaşım sunar. Şeffaflık ise, açık bir belgelendirme, iletişim ve paydaş katılımı yoluyla sağlanır. Bu sayede, yapay zekâ işlemlerinin tüm ilgili taraflarca anlaşılabilir ve erişilebilir olması amaçlanır.

AIMS Çerçevesinin Temel Bileşenleri

AIMS çerçevesi, birkaç temel bileşenden oluşur:

Etik İlkeler: Yapay zekâ sistemlerinin insan haklarına ve toplumsal değerlere saygı göstererek geliştirilmesini ve kullanılmasını sağlayan yönergeler.

Yönetişim Yapıları: Yapay zekâ faaliyetlerinin denetlenmesi, etik standartlar ve yasal gerekliliklere uygunluğun sağlanması için oluşturulan mekanizmalar.

Risk Yönetim Süreçleri: Yapay zekâ sistemleriyle ilişkili risklerin belirlenmesi, değerlendirilmesi ve azaltılması için kullanılan prosedürler.

Yapay Zekâ Sistemlerinde Sürekli İyileştirme

AIMS, organizasyonları sürekli iyileştirme zihniyetini benimsemeye teşvik eder. Geri bildirim döngüleri ve performans metrikleri kullanarak, yapay zekâ sistemlerinin etkinliği ve güvenilirliği zamanla artırılabilir. Bu yaklaşım, yapay zekâ teknolojilerinin ortaya çıkan zorluklara ve fırsatlara yanıt olarak evrimleşmesini ve etik standartlarla uyumlu kalmasını sağlar.

Yapay Zekâ Yönetim Sistemlerinde Etik İlkeler

AIMS uyumluluğu çerçevesinde etik ilkeler, yapay zekâ teknolojilerinin sorumlu bir şekilde geliştirilmesini ve uygulanmasını sağlamak için bir temel oluşturur. Bu etik ilkeler şunlardır:

Adalet: Yapay zekâ sistemlerinin önyargıları tekrarlamamasını veya artırmamasını sağlamak.

Hesap Verebilirlik: Yapay zekâ sistemi çıktılarından sorumlu olan organizasyonlar ve bireyler için net sorumluluk çizgileri oluşturmak.

Şeffaflık: Yapay zekâ sistemlerinin işleyişini paydaşlara anlaşılır hale getirmek.

Gizlilik: Yapay zekâ sistemleri tarafından işlenen kişisel verilerin korunmasını sağlamak.

Yapay Zekâ Sistemlerinde Hesap Verebilirlik ve İtiraz Hakkı

AIMS, yapay zekâ sistemlerinin hesap verebilir olmasını, yani alınan kararların sorumluluğunun izlenebilir olmasını vurgular. Ayrıca, itiraz hakkı mekanizmaları sayesinde paydaşlar, yapay zekâ kararlarını sorgulayabilir ve bu kararların etik standartlar ve toplumsal değerlerle uyumlu kalmasını sağlayabilirler.

Sorumlu Yapay Zekâ Kullanımını Sağlamak

AIMS altında sorumlu yapay zekâ kullanımı şu yollarla sağlanır:

Potansiyel etik tuzakları belirlemek için titiz risk değerlendirmeleri.

Yapay zekâ sistemlerinin istenilen şekilde çalışmasını sağlamak için sürekli izleme.

Etik kaygıları anlamak ve ele almak için paydaşlarla etkileşim.

Etik Yapay Zekâ Prensiplerini Etkili Bir Şekilde Uygulamak

AIMS çerçevesinde etik yapay zekâ prensiplerini etkili bir şekilde uygulamak için organizasyonlar şunları yapmalıdır:

Etik taahhütleri açıklayan net politikalar geliştirmek.

Çalışanları etik yapay zekâ kullanımı konusunda eğitmek.

Yapay zekâ geliştirme ve uygulama süreçlerinde etik karar verme sürecini destekleyen araçlar ve çerçeveler kullanmak.